西北农林科技大学机电学院傅隆生副教授在农林科学类期刊Precision Agriculture(中科院一区Top期刊)2021年第3期发表了题为“Fast and accurate detection of kiwifruit in orchard using improved YOLOv3‑tiny model”的研究论文。机电学院傅隆生副教授为第一作者和通讯作者,西北农林科技大学机电学院为第一单位。

在猕猴桃果园采摘劳动力短缺的背景下,设计一种具有人类感知能力的智能采摘机器人代替人力采摘具有重要意义。快速、有效地检测果园中的猕猴桃是是设计机器人收获系统的第一步。现有通过传统算法或两阶段深度学习算法的果实检测方法尽管结果可靠,但存在通用性差或配置要求高等缺点,且上述方法在检测速度上存在较大限制,难以实现现场实时检测。本研究根据猕猴桃图像的特征,通过将两个3×3和1×1的卷积核分别添加到YOLOv3-tiny模型的第五和第六个卷积层,开发了一种仅有27MB大小的深度学习模型,即DY3TNet。研究使用在自然果园中拍摄的猕猴桃图像(闪光、非闪光)对算法进行测试,并与包含Faster R-CNN和其他YOLO网络在内的5个深度学习模型进行比较。研究结果表明,模型对光变化较为敏感,在闪光图像上的检测效果优于非闪光图像,且DY3TNet模型的平均检测精度达到0.9005,处理一张分辨率为2352×1568像素的图像仅需要34 ms,性能优于其他所有模型,有望在全天候的自然果园中快速准确的实时检测猕猴桃果实。

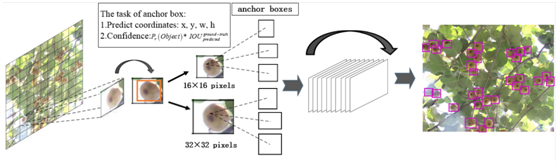

图1使用二维特征图进行猕猴桃检测的DY3TNet模型的流程

Models |

AP |

Detection speed (ms) |

Size (MB) |

Faster R-CNN with ZFNet |

0.7250 |

270±10.5a |

225 |

Faster R-CNN with VGG16 |

0.8761 |

347±12.0b |

512 |

YOLOv2 |

0.7860 |

54±0.4c |

192 |

YOLOv3-tiny |

0.8801 |

31±0.5d |

33 |

DY3TNet |

0.9005 |

34±0.4e |

27 |

注:第三列中相同的字母表示在0.05的水平上没有显着差异

论文链接:https://doi.org/10.1007/s11119-020-09754-y